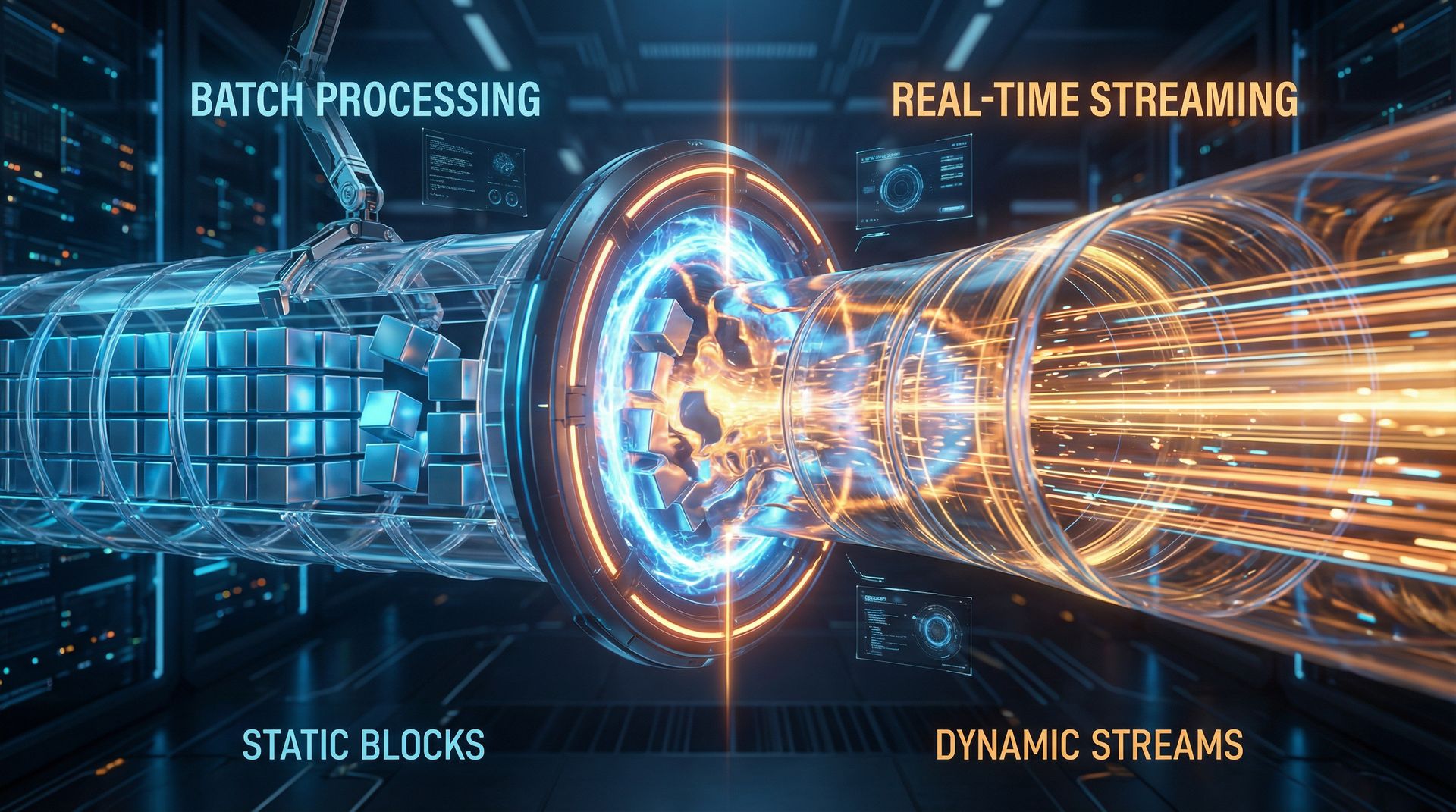

O mundo não acontece em lotes. Clientes não clicam em "Comprar" a cada 24 horas. Fraudes não esperam o job da madrugada para acontecer. No entanto, a maioria das arquiteturas de dados ainda opera em D+1. Neste artigo, analisamos o ROI da modernização para Event Streaming.

O Custo Oculto do Batch

Processamento em lote (Batch) parece mais simples e barato à primeira vista. Mas ele esconde custos operacionais significativos:

- Picos de Carga: Seus clusters ficam ociosos durante o dia e sobrecarregados na madrugada, exigindo superdimensionamento.

- Complexidade de Orquestração: Ferramentas como Airflow se tornam monstros ingovernáveis com milhares de dependências (DAGs).

- Custo de Oportunidade: Qual o valor de saber que um cliente abandonou o carrinho ontem? Zero. Saber agora permite recuperá-lo.

Streaming é "Difícil"?

Historicamente, sim. Manter clusters Kafka e escrever jobs Spark Streaming exigia engenheiros ultra-especializados. Mas o cenário mudou. Com plataformas gerenciadas (Confluent Cloud) e abstrações SQL (Flink SQL, ksqlDB), a barreira de entrada caiu drasticamente.

Hoje, um analista de dados pode escrever um SELECT contínuo que filtra eventos em tempo real, sem saber nada sobre partições ou offsets.

O Efeito Flywheel dos Dados em Movimento

Quando você adota uma arquitetura orientada a eventos, algo interessante acontece: os dados se tornam reutilizáveis. O mesmo evento de "Pedido Criado" que alimenta o dashboard de vendas em tempo real também dispara o e-mail de confirmação, atualiza o estoque e treina o modelo de recomendação.

Em Batch, cada um desses consumidores precisaria criar seu próprio pipeline de extração (ETL), duplicando lógica e custo. Em Streaming, o dado é produzido uma vez e consumido muitas vezes.

ROI Comprovado

Clientes Intelium que migraram pipelines críticos de Batch para Streaming reportaram redução de 40% no TCO de infraestrutura (devido ao alisamento de picos de carga) e aumento de 15% na conversão de vendas devido a ações contextualizadas em tempo real.

Conclusão

A migração não precisa ser Big Bang. Comece pelos casos de uso onde a latência tem valor direto de negócio (fraude, recomendação, logística). O futuro é contínuo, e sua arquitetura de dados deve refletir isso.